你的位置:开云体育最新网站 开云最新官方网站 - 登录入口 > 新闻资讯 > 开云体育(注:在措置超大高下文任务时-开云体育最新网站 开云最新官方网站 - 登录入口

开云体育(注:在措置超大高下文任务时-开云体育最新网站 开云最新官方网站 - 登录入口

发布日期:2025-09-13 07:23 点击次数:102

henry 发自 凹非寺

量子位 | 公众号 QbitAI

老黄对token密集型任务下手了。

刚刚,在AI Infra Summit上,英伟达书记推出专为措置百万token级别的代码生成和生成式视频愚弄的全新GPU——

VIDIA Rubin CPX GPU。

老黄暗示:Rubin CPX是首款为超大高下文AI量身定制的CUDA GPU,不错让模子“一语气”推理数百万token。

何况,RubinCPX还能让你越用越省钱:每投资1亿好意思元,就能获取50亿好意思元的token收益。(50倍,你就赚吧,老黄说的)

关于“老黄画的饼”,Cursor、Runway、Magic等行业大佬也暗示RubinCPX将永诀在代码坐褥力、生成式影像创作、以及大模子自主代理上带来龙套。

那么好了好了,这GPU到底什么来头?

首款专为超大高下文AI打造的CUDA GPURubin CPX基于NVIDIA Rubin架构,收受单片贪图,内置NVFP4筹谋资源,主打AI推理的高性能和高能效。

它的性能擢升,主要体现时以下几个方面:

在NVFP4精度下可提供高达30PFLOPS算力,作念到性能与精度兼顾。配备128GB高性价比GDDR7内存,顶住最尖刻的高下文责任负载。– 与NVIDIA GB300 NVL72系统比拟,把稳力机制措置速率擢升3倍,让模子在措置更长高下文序列时也不掉速。在这里,咱们不错浅薄地拿A100来对比一下。

在算力方面,相较于A100的FP16精度,Rubin CPX独特优化过的NVFP4不错终端几个量级的性能擢升。

而在内存方面,NVIDIA A100是40GB 或80GB,Rubin CPX则告成干到了128GB,让超大高下文措置毫无压力。

(注:在措置超大高下文任务时,GPU内存容量至关遑急:模子需要一次性加载数百万token的权重、激活值和中间筹谋成果,若是内存不够,就只可分批措置,既影响速率,也阻挡模子范畴)

单片就仍是这样强,组合还不错让它更强横!

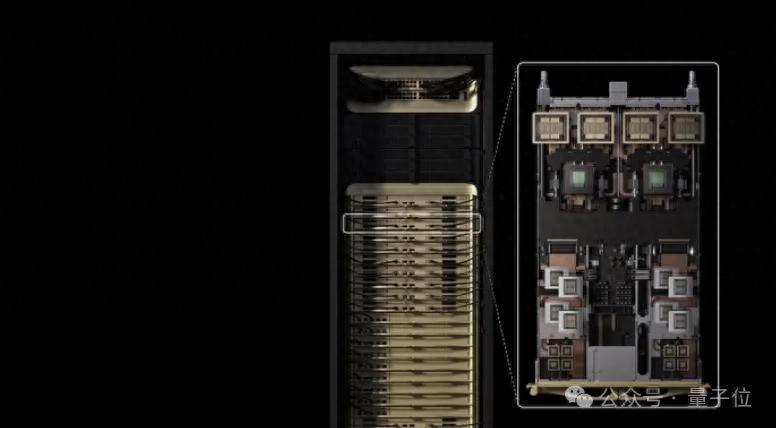

英伟达暗示,Rubin CPX还不错与NVIDIA Vera CPU和Rubin GPU协同责任,构周至新的NVIDIA Vera Rubin NVL144 CPX平台。

该平台在单机架内提供8EFLOPS的AI算力+100TB高速内存+每秒1.7PB的内存带宽,较NVIDIA GB300 NVL72系统的AI性能擢升了7.5倍。

*(注:1EFLOPS = 1000PFLOPS )

还没完,在此基础上,NVIDIA Vera Rubin NVL144 CPX还不错接入Quantum‑X800 InfiniBand 或Spectrum‑X以太网平台,终端大范畴多机互联筹谋,让性能再上一个台阶。

瞻望来岁认真推出就像前边提到的,NVIDIA Rubin CPX 在长高下文措置上终端了最高性能和最高token收益——远超现存系统的贪图极限。

老黄暗示,这将像RTX 修订了图形和物理AI同样,更变AI时间的高下文推明智力。

在内容愚弄中,它能把AI编程助手承诺单的代码生成器具,升级为大要交融并优化大范畴软件名方向复杂系统。

在视频措置方面,由于AI模子分析一小时内容就可能触及上百万token,龙套了传统GPU的算力极限。

为此,Rubin CPX将视频解码、编码和长高下文推理措置集成在单芯片中,为视频搜索和高质料生成式视频等万古花式愚弄提供前所未有的智力。

此外,Rubin CPX将得到NVIDIA圆善AI软件栈复旧,从加快基础才略到企业级软件一应俱全。

临了,NVIDIA Rubin CPX瞻望将于2026年底认真推出。

Token密集型任务就要不密集了(一年后版)

参考一语气[1]https://nvidianews.nvidia.com/news/nvidia-unveils-rubin-cpx-a-new-class-of-gpu-designed-for-massive-context-inference[2]https://www.runpod.io/articles/guides/nvidia-a100-gpu?utm_source=chatgpt.com

— 完 —

量子位 QbitAI · 头条号签约

热心咱们开云体育,第一时辰获知前沿科技动态

相关资讯